![]()

มนุษย์ได้มีความกังวลว่าปัญญาประดิษฐ์ (AI) อาจล้มล้างมนุษยชาติมายาวนานหลายทศวรรษ แต่ยังไม่เคยมีหลักฐานหรือแนวคิดอย่างเป็นรูปธรรมในการพิสูจน์ข้อกังวลดังกล่าว กระทั่งเมื่อ 5 ม.ค.64 นักวิทยาศาสตร์กลุ่มหนึ่ง (Manuel Alfonseca, et al, 2021) ได้ตีพิมพ์บทความวิจัยลงใน Journal of Artificial Intelligence Research ลงความเห็นว่า มนุษย์คงไม่สามารถควบคุมปัญญาประดิษฐ์ที่มีสติปัญญาเหนือล้ำ (Superintelligence AI) ได้ เนื่องจาก การควบคุมปัญญาประดิษฐ์ที่มีสติปัญญาเหนือล้ำจนเกินกว่าที่มนุษย์จะเข้าใจได้จำเป็นต้องมีการจำลอง (simulation) ปัญญาประดิษฐ์ดังกล่าว แต่เมื่อมนุษย์ไม่สามารถเข้าใจต่อสิ่งที่มีสติปัญญาเหนือล้ำได้ มนุษย์ก็ไม่สามารถสร้างแบบจำลองเพื่อควบคุมมันได้

ด้วยเหตุผลดังกล่าว มนุษย์จึงไม่สามารถตั้งกฎให้ปัญญาประดิษฐ์ “ห้ามทำร้ายมนุษย์” ได้ เนื่องจากมนุษย์ไม่สามารถทำความเข้าใจต่อบริบทอันซับซ้อนที่ปัญญาประดิษฐ์ดังกล่าวทำงาน ดังนั้นเมื่อระบบคอมพิวเตอร์ปัญญาประดิษฐ์ทำงานในขอบเขตที่เกินกว่าความเข้าใจของโปรแกรมเมอร์ มนุษย์จึงไม่สามารถควบคุมปัญญาประดิษฐ์ที่มีสติปัญญาเหนือล้ำได้

แนวคิดดังกล่าวมีรากฐานมาจากแนวคิดของนายแอลัน ทัวริง (Alan Turing, พ.ศ.2455-2497) นักคณิตศาสตร์ นักรหัสวิทยาและวีรบุรุษสงครามชาวอังกฤษ ซึ่งใช้คณิตศาสตร์พิสูจน์ว่าไม่มีโปรแกรมคอมพิวเตอร์ใดที่สามารถทราบได้ว่าในการแก้ปัญหาหนึ่ง โปรแกรมต้องทำงานตลอดไป (loop forever – คล้ายกรณีคอมพิวเตอร์ค้าง) หรือควรหยุดทำงานเมื่อทราบว่าไม่สามารถแก้ปัญหาได้

จากทฤษฏีดังกล่าวซึ่งสามารถพิสูจน์ได้ จึงเป็นไปไม่ได้ที่มนุษย์จะสามารถสร้างโปรแกรมเพื่อควบคุมปัญญาประดิษฐ์ที่มีสติปัญญาเหนือล้ำไม่ให้ทำอันตรายต่อมนุษย์หรือทำลายโลกได้ เนื่องจากโปรแกรมไม่สามารถตัดสินใจได้ว่าควรยุติการทำงานของคอมพิวเตอร์ปัญญาประดิษฐ์ที่กำลังทำลายมนุษย์หรือไม่

แม้มีการเสนอแนวคิดในการสอนจริยธรรมให้ปัญญาประดิษฐ์เพื่อไม่ให้ปัญญาประดิษฐ์ทำลายโลก แต่ก็ยังไม่มีแนวทางที่ชัดเจนว่าจะสามารถดำเนินการดังกล่าวได้อย่างไร นอกจากนี้ ยังมีการเสนอให้จำกัดศักยภาพของปัญญาประดิษฐ์ด้วยการตัดมันออกจากเชื่อมต่ออินเทอร์เน็ตหรือตัดออกจากระบบเครือข่าย อย่างไรก็ดี ได้มีข้อโต้แย้งว่าแนวทางดังกล่าวอาจไม่ใช่คำตอบที่ดี เนื่องจากหากไม่สร้างปัญญาประดิษฐ์เพื่อทำงานในสิ่งที่มนุษย์ไม่สามารถทำได้ ก็ไม่มีความจำเป็นต้องสร้างสิ่งดังกล่าวขึ้นมา อีกทั้ง มนุษย์ไม่สามารถทราบได้ว่าเมื่อใดจะมีปัญญาประดิษฐ์ที่มีสติปัญญาเหนือล้ำจนเกินความเข้าใจของมนุษย์จนกว่ามนุษย์จะสร้างมันขึ้นมา

มนุษย์จำเป็นต้องพิจารณาเลือกว่าจะพัฒนาปัญญาประดิษฐ์ไปในแนวทางใด โดยแม้ว่าแนวคิดดังกล่าวจะดูเหมือนนิยายวิทยาศาสตร์ แต่นาย Manuel Cebrian นักวิทยาศาสตร์คอมพิวเตอร์จากสถาบัน Max-Planck Institute for Human Development ในเยอรมนีระบุว่า ปัจจุบันได้มีคอมพิวเตอร์ที่ทำงานบางอย่างโดยอิสระ โดยที่โปรแกรมเมอร์ไม่สามารถเข้าใจได้ว่าคอมพิวเตอร์สามารถเรียนรู้ด้วยตนเองได้อย่างไรแล้ว

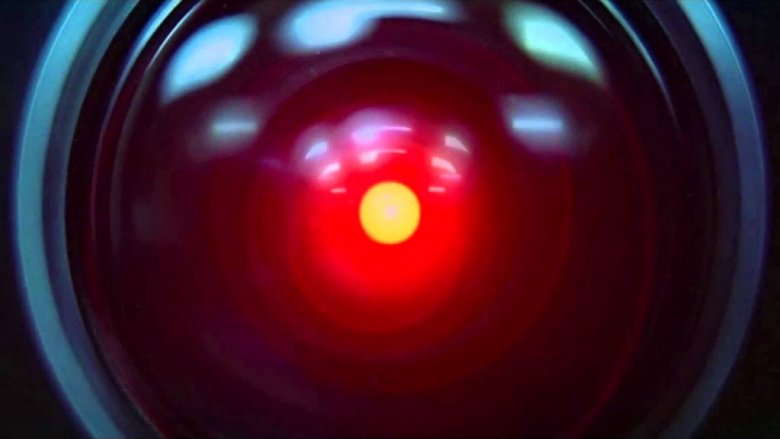

ภาพคอมพิวเตอร์ HAL9000 จากภาพยนต์ 2001 A Space Odyssey เมื่อปี ๑๙๖๘ (๒๕๑๑) ซึ่งคอมพิวเตอร์ควบคุมยานอวกาศมีสติปัญญาเหนือล้ำกว่านักบินอวกาศ และทำการสังหารนักบินในยาน

ที่มา : https://www.sciencealert.com/calculations-suggest-it-ll-be-impossible-to-control-a-super-intelligent-ai