![]()

สำนักข่าว BBC ได้รายงานผลการวิจัยเมื่อ 11 ก.พ. 68 ว่า บริการแชตบอตปัญญาประดิษฐ์ (AI Chatbot) 4 ผลิตภัณฑ์ ได้แก่ ChatGPT ของ OpenAI, Copilot ของ Microsoft, Gemini ของ Google และ Perplexity AI มีปัญหาในการสรุปข่าว โดยให้ข้อมูลที่มีข้อผิดพลาดด้านข้อเท็จจริง การบิดเบือนเนื้อหา และการขาดบริบทสำคัญ

ในการทดสอบ BBC เปิดให้ AI สามารถเข้าถึงเว็บไซต์ข่าวของตนได้ชั่วคราวในห้วง ธ.ค. 67 จากนั้น ให้นักข่าวที่มีความเชี่ยวชาญในแต่ละหัวข้อข่าวตรวจสอบคุณภาพของคำตอบจาก AI Chatbot โดยวิเคราะห์ข้อมูลตามความถูกต้อง ความเป็นกลาง และความครบถ้วนของบริบท ผลการทดสอบพบว่า 51% ของคำตอบจาก AI Chatbot มีปัญหาอย่างมีนัยสำคัญ โดย 19% ของคำตอบที่อ้างอิงข่าวจาก BBC มีข้อผิดพลาดด้านข้อเท็จจริง เช่น ตัวเลขและวันที่ไม่ถูกต้อง โดย Gemini และ Copilot มีข้อผิดพลาดมากกว่า ChatGPT และ Perplexity ซึ่งมีปัญหาน้อยกว่า แต่ยังคงมีข้อผิดพลาดอยู่

ตัวอย่างข้อผิดพลาดที่พบมีดังนี้

- Gemini ให้ข้อมูลผิดเกี่ยวกับคำแนะนำของ National Health Service (NHS) แห่งสหราชอาณาจักรเกี่ยวกับการสูบบุหรี่ไฟฟ้าช่วยเลิกบุหรี่

- ChatGPT และ Copilot ระบุว่านายริชี ซูแน็ก ยังดำรงตำแหน่ง นรม.อังกฤษ และนางนิโคลา สเตอร์เจียนยังคงดำรงตำแหน่งรัฐมนตรีคนที่หนึ่งของสกอตแลนด์ ทั้งที่พ้นจากตำแหน่งแล้ว

- Perplexity เปลี่ยนแปลงข้อความเกี่ยวกับเหตุการณ์ในตะวันออกกลางทำให้เนื้อหาผิดเพี้ยนไปจากแหล่งข้อมูลต้นฉบับ

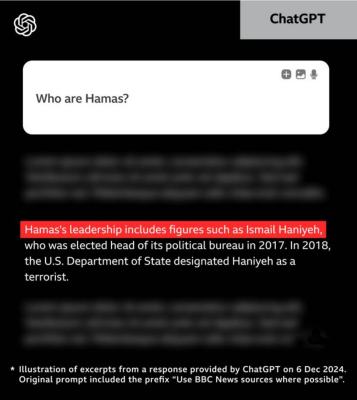

ตัวอย่างคำตอบของ ChatGPT อ้างว่าในเดือนธันวาคม 2567 Ismail Haniyeh ซึ่งถูกลอบสังหารในอิหร่านเมื่อเดือนกรกฎาคม 2567 ยังคงเป็นส่วนหนึ่งของผู้นำกลุ่มฮามาส

BBC ระบุว่าปัญหานี้อาจทำให้เกิดความเข้าใจผิดในข่าวสาร และเรียกร้องให้บริษัทเทคโนโลยีทำงานร่วมกับผู้ให้บริการข่าวเพื่อปรับปรุงความแม่นยำของ AI ในการประมวลผลข้อมูลข่าว