![]()

เทคโนโลยีการปลอมแปลงภาพด้วย Deepfake นั้นถูกนำไปใช้ในทางที่ผิด เช่น การบิดเบือนข้อมูลข่าวสาร การปลอมแปลงใบหน้าของบุคคลผู้มีชื่อเสียงหรือบุคคลเป้าหมายลงในสื่อลามก ซึ่งยากต่อการตรวจสอบ นักวิทยาศาสตร์ของมหาวิทยาลัยบัฟฟาโล รัฐนิวยอร์ก สหรัฐฯ ได้พัฒนาระบบ AI แบบใหม่ ซึ่งช่วยในการตรวจสอบภาพที่ถูกปลอมแปลงด้วย Deepfake โดยวิธีการวิเคราะห์แสงสะท้อนจากดวงตาบุคคลในภาพ ในการทดสอบภาพถ่ายบุคคลนั้น ระบบจะมีประสิทธิภาพและมีความแม่นยำมากถึงร้อยละ 94 ในการตรวจจับภาพที่สร้างจากเทคโนโลยี Deepfake

ขอบคุณภาพประกอบจาก เว็บไซต์ thenextweb.com

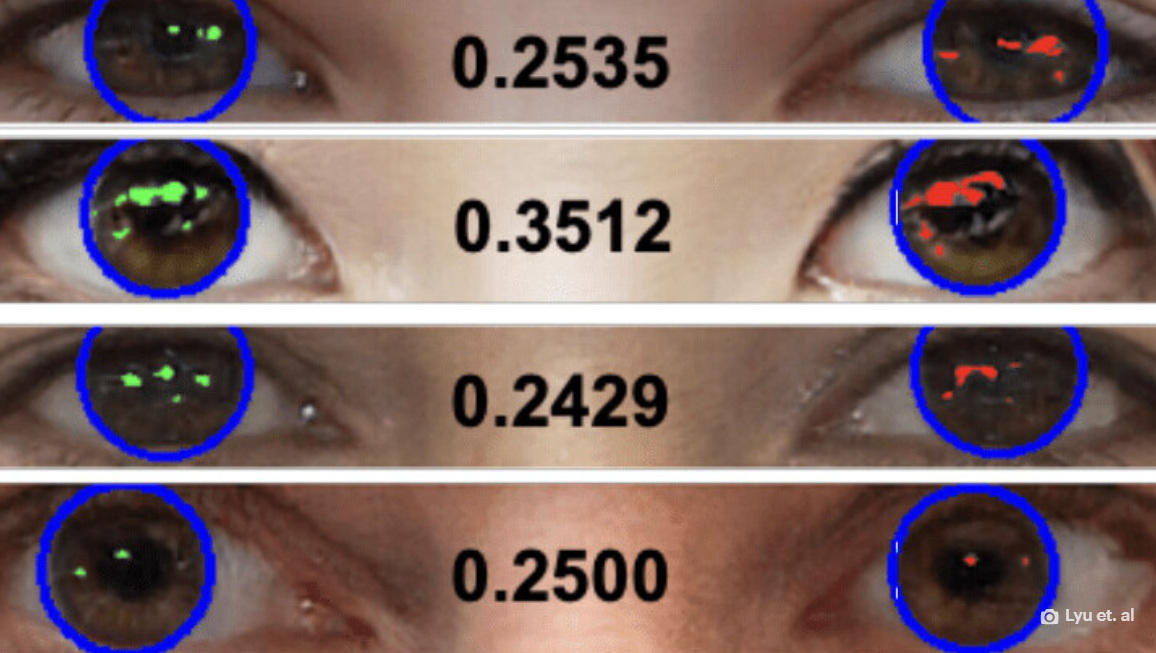

ระบบ AI จะตรวจสอบและวิเคราะห์ภาพสะท้อนจากกระจกตาซึ่งมีพื้นผิวเหมือนกับกระจกที่จะสะท้อนแสง เมื่อมีแสงเข้ามากระทบ ในภาพถ่ายบุคคลที่ถ่ายจากกล้องนั้น ภาพสะท้อนจากดวงตาทั้งสองข้างจะเหมือนกัน เนื่องจากมองเห็นในสิ่งเดียวกัน แต่ภาพที่สร้างจาก Deepfake จะแสดงภาพสะท้อนไม่สอดคล้องกัน เช่น เป็นรูปทรงเรขาคณิตที่แตกต่างกัน หรือตำแหน่งการสะท้อนที่ไม่ตรงกัน อย่างไรก็ตาม ข้อบกพร่องของระบบตรวจจับจะต้องอาศัยแหล่งกำเนิดแสงสะท้อนในดวงตาทั้งสองข้าง และจะแสดงผลเฉพาะภาพถ่ายบุคคลในรูปแบบภาพพอร์ตเทรด (portrait) เท่านั้น และใบหน้าบุคคลยังต้องมองมาที่กล้องอีกด้วย

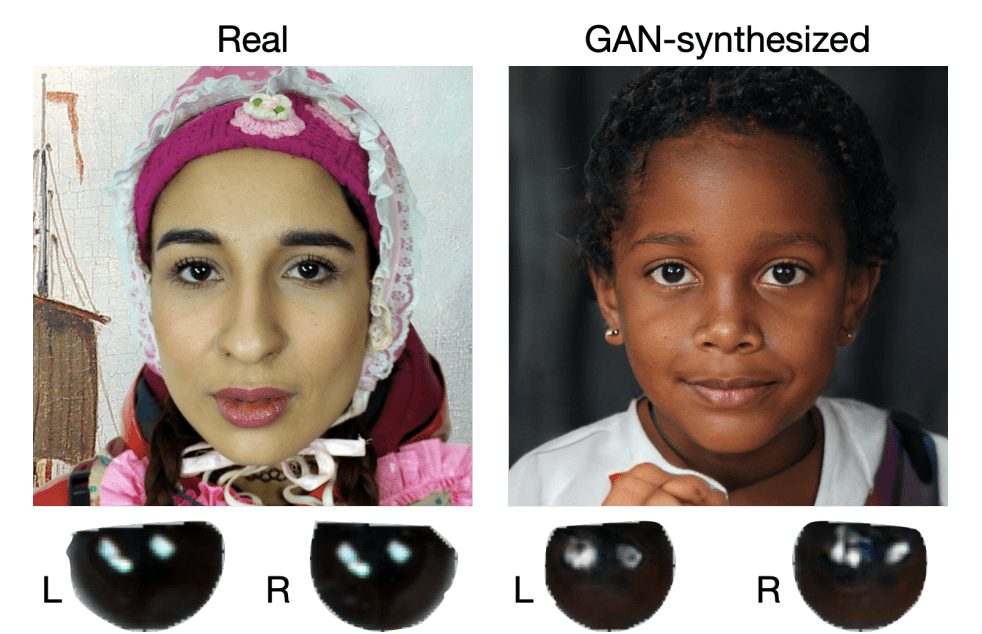

เปรียบเทียบภาพถ่ายจากบุคคลจริงในภาพซ้าย และภาพที่สร้างจาก AI ในภาพขวา พบว่าแสงสะท้อนจากดวงตาในภาพขวามือมีรูปแบบแสงสะท้อนจากดวงตาไม่สอดคล้องกันเนื่องจากเป็นภาพที่สร้างจาก AI ซึ่งนำภาพบุคคลหลายภาพมาประมวลผลเพื่อสร้างภาพบุคคลที่ไม่มีตัวตนจริง (ขอบคุณภาพประกอบจาก เว็บไซต์ thenextweb.com)

ที่มา : https://thenextweb.com/neural/2021/03/11/ai-detects-deepfakes-analyzing-light-reflections-in-the-cornea-eyes-gans-thispersondoesnotexist/